지도학습(supervised learning)의 변수 선택(Feature Selection)의 종류

- Filter 방법

- 다중 t-검정 기반(분류분석인 경우)

- 다중 correlation 기반(회귀분석인 경우)

- Wrapper 방법

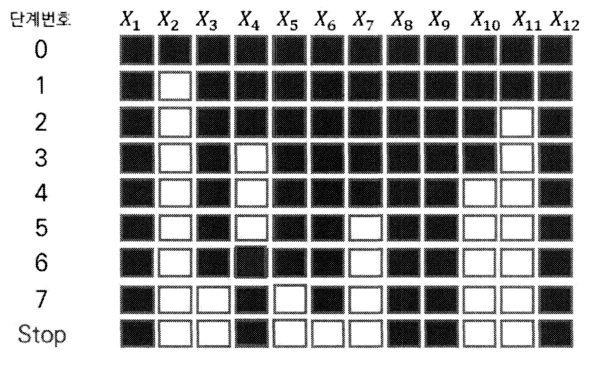

- All Subsets(모든 가능 조합 다 해보기)

- Backward Elimination(후진 소거법)

- Forward Selection(전진 선택법)

- Stepwise Elimination/Selection(단계적 제거/선택법)

- Backward, Forward 조합

- Embedding 방법(모델 내장)

- Ridge(L2 정규화)

- Lasso(L1 정규화)

- Elastic Net(L1, L2 정규화)

- Decision tree

- Random Forest 등

Wrapper 방법

sklearn의 RFE(후진제거법의 일종)을 사용할 수 있다.(변수 개수를 지정해야하는 치명적 단점이 있다.)

장점

- 원하는 모형에 최적화된 변수 선택 방법이다.

- Y변수에 유의한 영향을 미치는 X변수 조합을 찾을 수 있다.

- 모델의 성능향상에 기여한다.

단점

- 사용되는 모델에만 국한된다(타 모델은 동일 feature로 성능이 안 나올 수도 있음)

- X변수의 수가 많을때는 최적의 변수 조합을 찾기가 매우 어렵다.

- 사용 방법에 따라 결과물(solution)이 상이하다.

'ML | DL | Big data > Data Science' 카테고리의 다른 글

| 상관계수 검정 - Pearson, Spearman, Kendall (0) | 2023.03.08 |

|---|---|

| 단순/다중 선형회귀 모형 - 유의성 검정 / 적합도 측정 (1) | 2023.03.06 |

| 비모수 검정 - Wilcoxon rank-sum(Mann-Whitney U) / Wilcoxon Signed rank test (0) | 2023.03.02 |

| 범주형 자료 검정 - Chi-Squared Test (0) | 2023.03.02 |

| 분산 분석 - Analysis of Variance(ANOVA) (0) | 2023.03.02 |

| 정규성 검정 및 변환 (0) | 2023.02.28 |

댓글